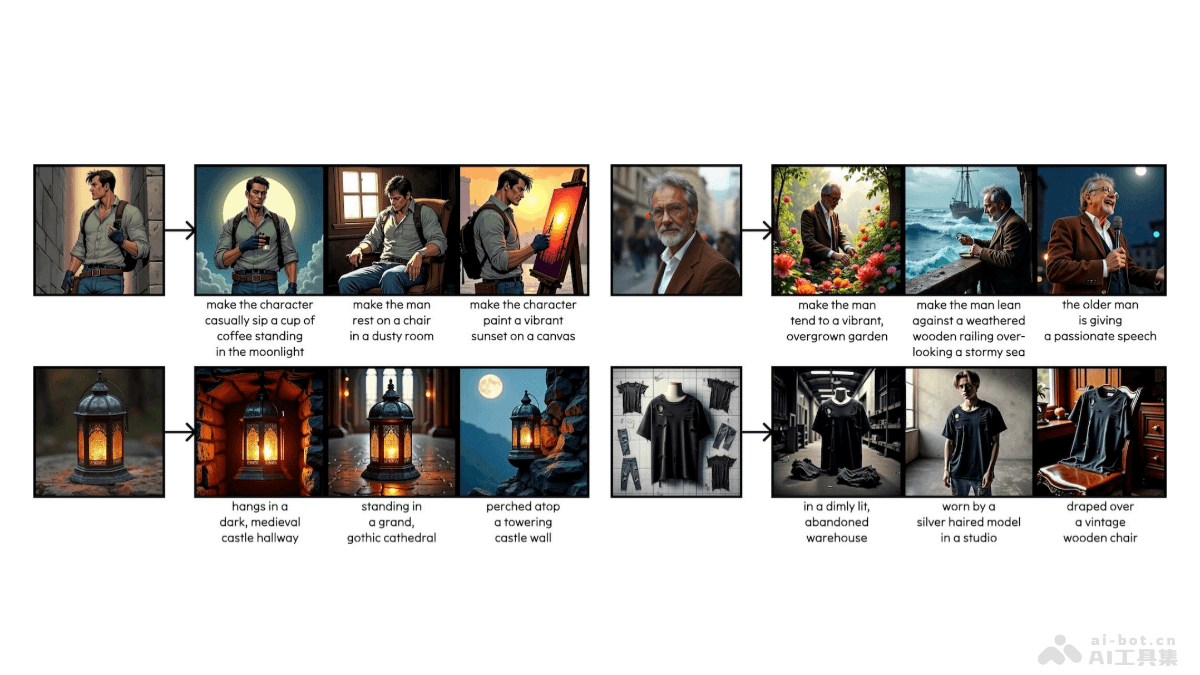

Diffusion Self-Distillation(扩散自蒸馏,简称DSD)是斯坦福大学吴佳俊团队推出的零样本定制图像生成技术,用预训练的文本到图像扩散模型自动生成数据集,并将其微调为能进行文本条件的图像到图像任务的模型。Diffusion Self-Distillation基于生成图像网格和视觉语言模型筛选,创建出高质量的配对数据集,进而在无需人工干预的情况下,实现在任意上下文中对任意实例进行身份保持的定制图像生成。这种方法在保持身份一致性的任务上表现出色,与逐实例调优技术竞争,且无需测试时优化。

Diffusion Self-Distillation的主要功能身份保持的定制图像生成:在不同的上下文中生成特定实例的图像,同时保持该实例的身份特征。零样本学习:无需针对特定实例的训练数据,直接应用预训练模型进行生成任务。自动化数据配对:基于自生成的数据集和视觉语言模型的辅助,自动创建高质量的训练数据对。图像到图像的转换:支持将输入图像转换为具有特定文本条件的输出图像,例如改变光照、风格或其他视觉属性。广泛的适用性:适用于多种文本条件图像生成任务,包括个性化、重光照、深度控制和指令跟随等。Diffusion Self-Distillation的技术原理预训练模型的上下文生成能力:基于预训练的文本到图像扩散模型的上下文生成能力创建图像网格。数据配对与筛选:用视觉语言模型(VLMs)辅助筛选,从生成的图像网格中创建出大规模高质量的配对数据集。微调扩散模型:用筛选后的配对数据集对预训练的文本到图像扩散模型进行微调,将其转化为支持文本+图像条件的图像生成模型。并行处理架构:推出一种并行处理架构,将输入图像视为视频序列的第一帧,并生成两帧视频作为输出。第一帧重建输入图像,第二帧是编辑后的输出,实现有效信息交换。信息交换与编辑:在两帧视频之间建立身份映射和条件编辑目标,让模型能捕捉复杂的语义并执行复杂的编辑。Diffusion Self-Distillation的项目地址项目官网:primecai.github.io/dsdarXiv技术论文:https://arxiv.org/pdf/2411.18616Diffusion Self-Distillation的应用场景艺术创作:艺术家在不同的风格和背景下创作作品,同时保持艺术作品中角色或物体的一致性。游戏开发:在游戏设计中,快速生成具有一致身份特征的游戏角色或物品的多种变体,适应不同的游戏场景。电影和动画制作:电影制作人在不同的场景中保持角色的一致性,或在不同的光照条件下重新渲染场景。广告和营销:营销人员定制广告图像,确保品牌形象在各种广告媒介中保持一致。个性化商品:根据用户上传的图片生成个性化的商品,如定制T恤、杯子和手机壳等,同时保持品牌元素的一致性。

Diffusion Self-Distillation的主要功能身份保持的定制图像生成:在不同的上下文中生成特定实例的图像,同时保持该实例的身份特征。零样本学习:无需针对特定实例的训练数据,直接应用预训练模型进行生成任务。自动化数据配对:基于自生成的数据集和视觉语言模型的辅助,自动创建高质量的训练数据对。图像到图像的转换:支持将输入图像转换为具有特定文本条件的输出图像,例如改变光照、风格或其他视觉属性。广泛的适用性:适用于多种文本条件图像生成任务,包括个性化、重光照、深度控制和指令跟随等。Diffusion Self-Distillation的技术原理预训练模型的上下文生成能力:基于预训练的文本到图像扩散模型的上下文生成能力创建图像网格。数据配对与筛选:用视觉语言模型(VLMs)辅助筛选,从生成的图像网格中创建出大规模高质量的配对数据集。微调扩散模型:用筛选后的配对数据集对预训练的文本到图像扩散模型进行微调,将其转化为支持文本+图像条件的图像生成模型。并行处理架构:推出一种并行处理架构,将输入图像视为视频序列的第一帧,并生成两帧视频作为输出。第一帧重建输入图像,第二帧是编辑后的输出,实现有效信息交换。信息交换与编辑:在两帧视频之间建立身份映射和条件编辑目标,让模型能捕捉复杂的语义并执行复杂的编辑。Diffusion Self-Distillation的项目地址项目官网:primecai.github.io/dsdarXiv技术论文:https://arxiv.org/pdf/2411.18616Diffusion Self-Distillation的应用场景艺术创作:艺术家在不同的风格和背景下创作作品,同时保持艺术作品中角色或物体的一致性。游戏开发:在游戏设计中,快速生成具有一致身份特征的游戏角色或物品的多种变体,适应不同的游戏场景。电影和动画制作:电影制作人在不同的场景中保持角色的一致性,或在不同的光照条件下重新渲染场景。广告和营销:营销人员定制广告图像,确保品牌形象在各种广告媒介中保持一致。个性化商品:根据用户上传的图片生成个性化的商品,如定制T恤、杯子和手机壳等,同时保持品牌元素的一致性。