微软和中国科学技术大学

(中国AI网 2024年10月14日)神经辐射场NeRF在新颖视图合成中显示出令人印象深刻的结果,由于其连续表示场景的能力,这在在AR和VR中尤为突出。然而,当只有少数输入视图图像可用时,NeRF倾向于过度拟合给定视图,从而使估计的像素深度共享几乎相同的值。

与之前通过引入复杂先验或额外监督来进行正则化的方法不同,微软和中国科学科技大学提出了一种简单而有效的方法:在输入视图之间显式构建深度感知一致性来应对这一挑战。

团队的关键见解是,通过强制在不同的输入视图中重复采样相同的空间点,能够加强视图之间的相互作用,从而缓解过拟合问题。

为了实现这一点,研究人员在分层表示构建神经网络,所以采样点可以在多个离散平面重新采样。另外,为了正则化未见过的目标视图,团队将来自不同输入视图的渲染颜色和深度约束为相同。尽管简单,但大量的实验表明,所提出的方法可以比最先进方法获得更好的合成质量。

新视图合成是计算机视觉和计算机图形学的一项基本任务,其目的是将给定的多个给定的输入视图图像绘制成新的视图图像。近年来,神经辐射场因其强大的连续场景表示能力和新颖视图合成性能而越来越受到人们的欢迎。

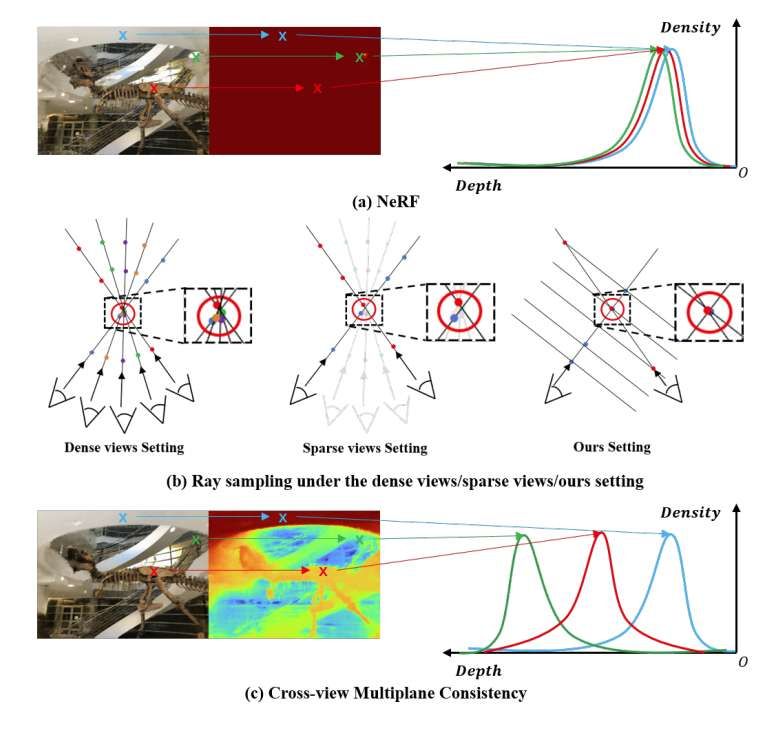

然而,NeRF及其变体的成功在很大程度上取决于输入视图的数量。如下面的图2a所示,当只给出几个输入视图时,NeRF倾向于过拟合输入视图,导致像素的估计深度共享几乎相同的值。原则上,这种过拟合问题可以通过将不同场景的先验信息纳入神经网络来缓解。不过,这种方法需要昂贵的预训练成本,并且预训练的场景通常与目标场景存在域间隙。

最近,通过引入外部监督、伪视图或物理先验,在缓解过拟合问题方面取得了显著进展。尽管有效,但大多数方法要么忽略了跨多个视图的一致性,要么只将跨视图一致性强加于图像级别,从而限制了性能。

为了应对这一挑战,微软和中国科学技术大学团队提出了一个假设:由于输入视图较少,每个光线中的采样点很少用于渲染其他视图,所以神经网络倾向于记住每个输入视图的颜色而不是学习底层几何。

为了验证这一假设,团队提出了跨视图多平面一致性。其中,在呈现不同视图时强制采样点保持相同,如图2b所示。

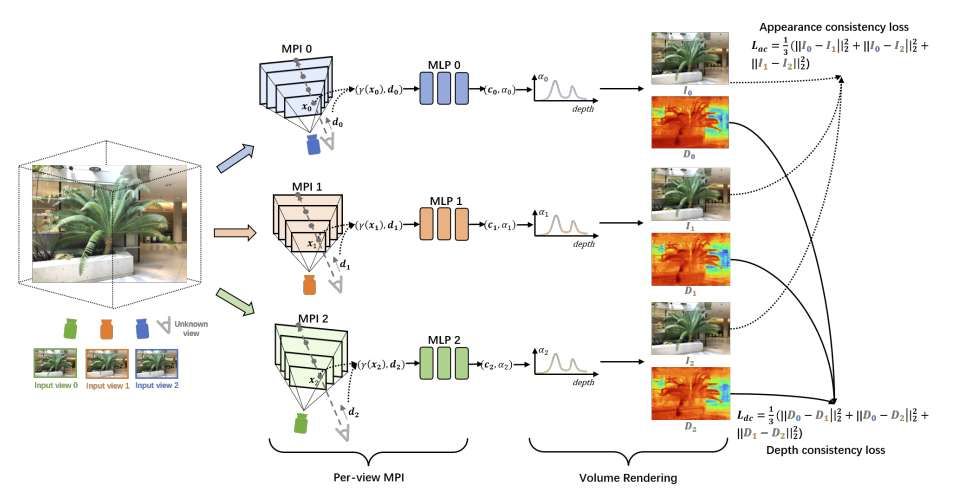

通过这种方式,采样点能够呈现到不同视图的图像中,从而实现跨视图的深度感知一致性。更具体地说,对于每个输入视图,通过将输入视图作为Multiplane Images(MPI)的参考视图来构建单独的分层表示。

所以,基于离散的多平面表示,所有采样点强制分布在相同的固定平面。给定每个输入视图的多平面表示,目标是在优化过程中在多平面施加跨视图一致性。

团队在两个方面认识到这一点:

对于输入视图的真实图像可用,使用重建损失来优化每个MPI,使渲染的输入视图图像与真实输入视图图像之间的差异最小化。对于缺乏真实图像的未见视图,利用底层一致性:从不同输入视图呈现的颜色和深度应该保持相同。所以,能够实现跨视图多平面一致性。团队在常见的LLFF和Shiny数据集验证了假设和建议,并实现了最先进的性能。

相关论文:CMC: Few-shot Novel View Synthesis via Cross-view Multiplane Consistency

总的来说,研究人员提出了一种基于交叉多平面一致性的few shot新视图合成技术。通过多平面图像绘制不同视图时,通过强制采样点相同来解决few shot视图合成的过拟合问题。这是基于给定稀疏输入视图图像的假设,其中每个光线中的采样点很少用于呈现其他视图,所以导致神经网络记住输入视图而不是学习底层几何。

然后,为了增强不同视图之间的交互,团队建议通过将每个输入视图视为参考视图,然后利用外观和深度一致性损失来构建每个视图的MPI。

他们进一步解释了过拟合问题,并给出了背后的直觉。为了验证假设和方法,研究人员在大量复杂的现实场景中进行了实验,其中,提出的解决方案可以实现最先进的few shot新颖视图合成,无需任何场景先验或复杂的手工采样策略。