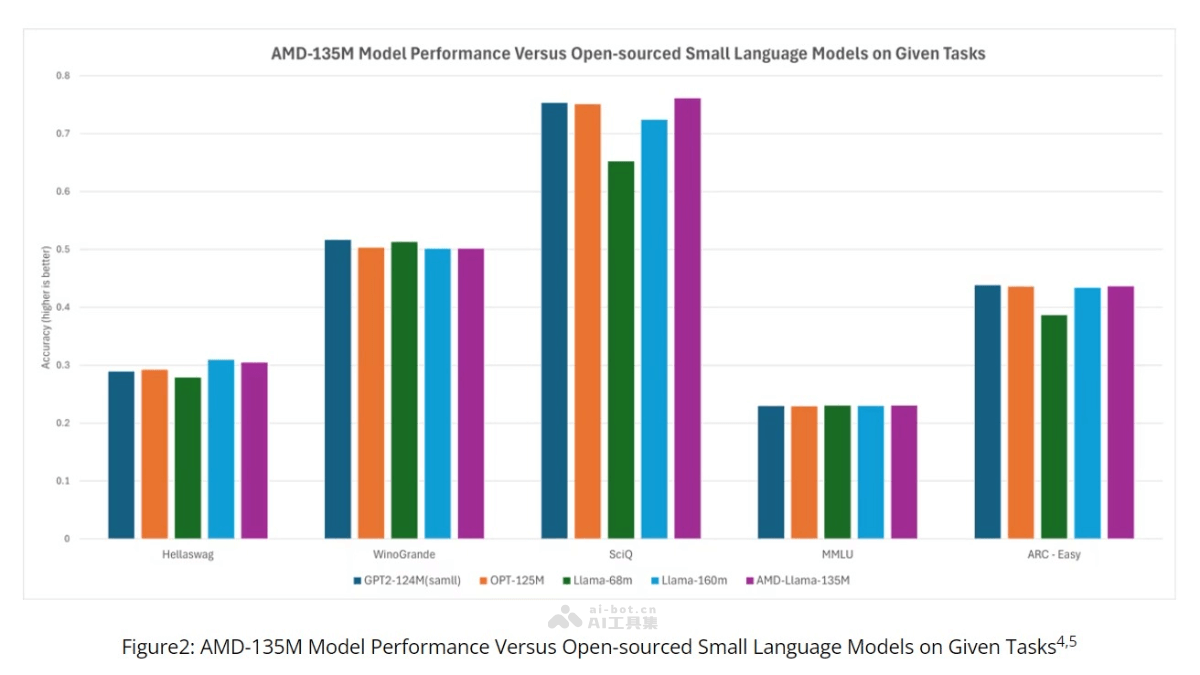

AMD-135M是AMD推出的首款小型语言模型(SLM),为特定用例提供性能与资源消耗之间的平衡。基于LLaMA2模型架构,在AMD Instinct MI250加速器上训练,基于670亿个token,AMD-135M分为两个版本,通用文本的AMD-Llama-135M和针对代码的AMD-Llama-135M-code。AMD-135M采用推测解码技术,能在每次前向传递中生成多个token,提高推理速度减少内存占用。在性能方面,AMD-135M 在各种自然语言处理任务上的表现与市场上其他同类模型相当。例如,在 Humaneval 数据集上使用 MI250 GPU 时,实现大约 32.31% 的通过率,是一个强大的性能指标 。

AMD-135M的主要功能文本生成:能生成连贯的文本,支持聊天机器人、内容创作等应用。代码生成:基于微调版本AMD-Llama-135M-code,支持代码生成和辅助编程。自然语言理解:理解输入文本的意图和上下文,用于问答系统、摘要生成等。多平台兼容性:在不同的硬件平台上运行,包括AMD的GPU和CPU。AMD-135M的技术原理推测解码:通过小型草稿模型生成候选token,再由大型目标模型验证,提高推理效率。自回归方法:传统的生成方法,每次前向传递生成一个token,但通过推测解码技术得到优化。多头注意力机制:使用多头注意力机制来提高模型对文本中不同部分之间关系的捕捉能力。位置编码:使用相对位置编码(RoPE)来保持序列中单词的顺序信息。激活函数:使用Swiglu激活函数,这是一种专为语言模型设计的激活函数。Layer Norm:使用RMSNorm(Root Mean Square Normalization)来稳定训练过程。模型架构:基于LLaMA-2模型架构,具有12层,768隐藏单元,以及其他技术规格。AMD-135M的项目地址项目官网:amd-first-slm-135m-model-fuels-ai-advancementsHuggingFace模型库:https://huggingface.co/amd/AMD-Llama-135mAMD-135M的应用场景聊天机器人:作为聊天机器人的后端,提供自然语言理解和生成能力,实现与用户的互动对话。内容创作:辅助写作,生成文章、故事或其他文本内容的草稿。编程辅助:基于AMD-Llama-135M-code版本,帮助开发者生成代码片段,提供编程建议和自动补全。语言翻译:模型主要针对英语,但架构适应其他语言,用于机器翻译任务。文本摘要:自动生成文本的摘要,用在新闻、文章或报告的快速概览。

AMD-135M的主要功能文本生成:能生成连贯的文本,支持聊天机器人、内容创作等应用。代码生成:基于微调版本AMD-Llama-135M-code,支持代码生成和辅助编程。自然语言理解:理解输入文本的意图和上下文,用于问答系统、摘要生成等。多平台兼容性:在不同的硬件平台上运行,包括AMD的GPU和CPU。AMD-135M的技术原理推测解码:通过小型草稿模型生成候选token,再由大型目标模型验证,提高推理效率。自回归方法:传统的生成方法,每次前向传递生成一个token,但通过推测解码技术得到优化。多头注意力机制:使用多头注意力机制来提高模型对文本中不同部分之间关系的捕捉能力。位置编码:使用相对位置编码(RoPE)来保持序列中单词的顺序信息。激活函数:使用Swiglu激活函数,这是一种专为语言模型设计的激活函数。Layer Norm:使用RMSNorm(Root Mean Square Normalization)来稳定训练过程。模型架构:基于LLaMA-2模型架构,具有12层,768隐藏单元,以及其他技术规格。AMD-135M的项目地址项目官网:amd-first-slm-135m-model-fuels-ai-advancementsHuggingFace模型库:https://huggingface.co/amd/AMD-Llama-135mAMD-135M的应用场景聊天机器人:作为聊天机器人的后端,提供自然语言理解和生成能力,实现与用户的互动对话。内容创作:辅助写作,生成文章、故事或其他文本内容的草稿。编程辅助:基于AMD-Llama-135M-code版本,帮助开发者生成代码片段,提供编程建议和自动补全。语言翻译:模型主要针对英语,但架构适应其他语言,用于机器翻译任务。文本摘要:自动生成文本的摘要,用在新闻、文章或报告的快速概览。