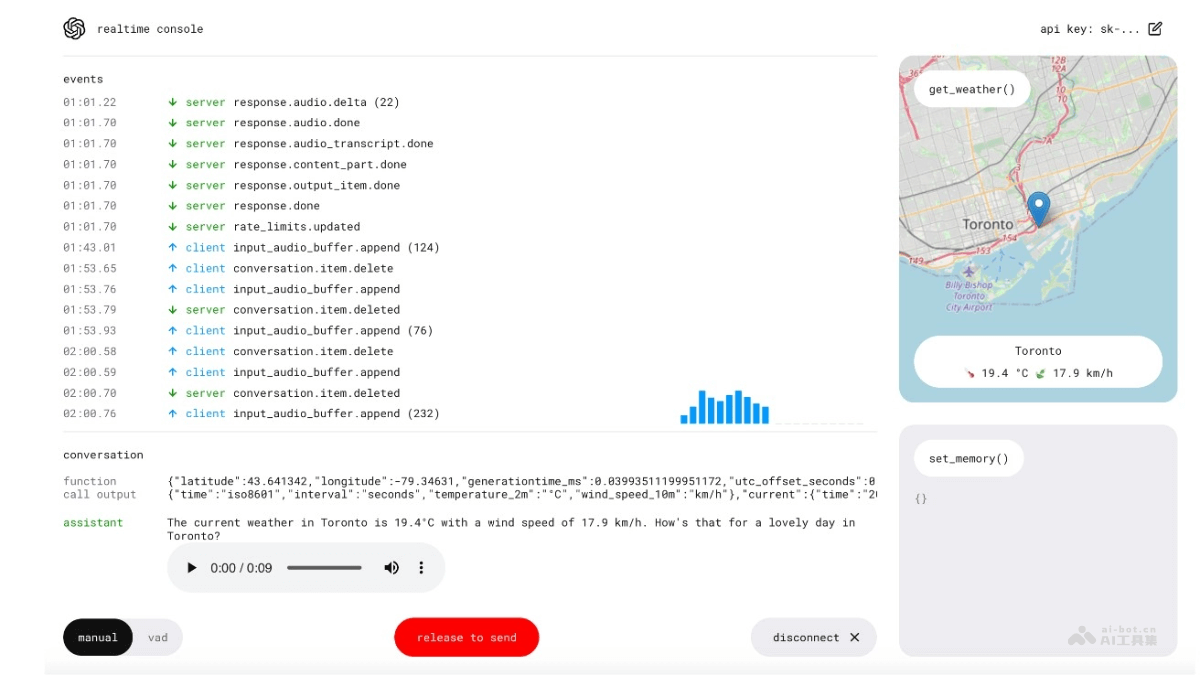

Realtime API是OpenAI推出的一种低延迟、多模态的对话式API,支持文本和音频作为输入和输出。Realtime API允许开发者构建接近实时的交互体验,例如语音对语音的应用程序。包括原生的语音处理能力、自然的声音输出,以及同时处理多种模态的输出。公测版本支持开发者用API目前支持的6种预设进行语音交互。开发者用WebSocket连接到API,发送和接收JSON格式的事件,实现实时的对话和交互。Realtime API适用于需要快速响应和自然对话的应用场景,如客户服务、语言学习、游戏和娱乐等。

Realtime API的主要功能实时语音处理:支持实时语音到语音的交互,无需文本转换,直接处理语音输入和输出。自然语音合成:提供自然、流畅的语音输出,包括不同的语调、情感和口音。多模态交互:结合文本和音频输出,提供更丰富的交互体验。WebSocket连接:用WebSocket协议实现持久连接,保持会话状态。事件驱动的交互:基于事件的通信机制,允许灵活的请求和响应处理。函数调用集成:允许在对话中集成函数调用,使AI执行特定动作或检索信息。音频格式支持:支持多种音频格式,包括原始16位PCM和G.711编码。Realtime API的技术原理WebSocket通信:用WebSocket协议建立一个持久的连接,允许实时双向数据流。使API能即时响应输入并发送输出。状态管理:Realtime API是有状态的,在会话期间维护交互状态。包括用户输入、系统指令、会话配置等。事件驱动架构:API基于事件驱动架构,客户端和服务器通过发送和接收事件交互。事件可以是文本消息、音频数据、函数调用请求等。语音活动检测(VAD):在服务器VAD模式下,服务器会运行语音活动检测算法确定何时开始和结束语音输入。有助于减少不必要的处理和延迟。音频处理:支持音频输入的缓冲、提交和转录。客户端向服务器发送音频数据,服务器将数据转换成文本或直接生成语音响应。Realtime API的项目地址项目官网:platform.openai.com/docs/guides/realtimeGitHub仓库:console:https://github.com/openai/openai-realtime-consolebeta:https://github.com/openai/openai-realtime-api-betaRealtime API的应用场景虚拟助手:提供实时语音交互的虚拟助手,帮助用户执行任务,如设置提醒、搜索信息等。客户服务:在呼叫中心使用,提供更自然的语音交互体验,自动回答客户问题或引导他们完成交易。语言学习:用于语言学习应用,提供实时语音反馈,帮助学习者练习发音和听力。实时翻译:为多语言会议或个人提供实时语音翻译服务。智能家居控制:集成到智能家居设备中,允许用户通过语音控制家中的各种智能设备。游戏:在游戏中提供自然的非玩家角色(NPC)对话,增强沉浸感。辅助技术:为有视觉或行动障碍的人士提供语音控制的辅助技术。

Realtime API的主要功能实时语音处理:支持实时语音到语音的交互,无需文本转换,直接处理语音输入和输出。自然语音合成:提供自然、流畅的语音输出,包括不同的语调、情感和口音。多模态交互:结合文本和音频输出,提供更丰富的交互体验。WebSocket连接:用WebSocket协议实现持久连接,保持会话状态。事件驱动的交互:基于事件的通信机制,允许灵活的请求和响应处理。函数调用集成:允许在对话中集成函数调用,使AI执行特定动作或检索信息。音频格式支持:支持多种音频格式,包括原始16位PCM和G.711编码。Realtime API的技术原理WebSocket通信:用WebSocket协议建立一个持久的连接,允许实时双向数据流。使API能即时响应输入并发送输出。状态管理:Realtime API是有状态的,在会话期间维护交互状态。包括用户输入、系统指令、会话配置等。事件驱动架构:API基于事件驱动架构,客户端和服务器通过发送和接收事件交互。事件可以是文本消息、音频数据、函数调用请求等。语音活动检测(VAD):在服务器VAD模式下,服务器会运行语音活动检测算法确定何时开始和结束语音输入。有助于减少不必要的处理和延迟。音频处理:支持音频输入的缓冲、提交和转录。客户端向服务器发送音频数据,服务器将数据转换成文本或直接生成语音响应。Realtime API的项目地址项目官网:platform.openai.com/docs/guides/realtimeGitHub仓库:console:https://github.com/openai/openai-realtime-consolebeta:https://github.com/openai/openai-realtime-api-betaRealtime API的应用场景虚拟助手:提供实时语音交互的虚拟助手,帮助用户执行任务,如设置提醒、搜索信息等。客户服务:在呼叫中心使用,提供更自然的语音交互体验,自动回答客户问题或引导他们完成交易。语言学习:用于语言学习应用,提供实时语音反馈,帮助学习者练习发音和听力。实时翻译:为多语言会议或个人提供实时语音翻译服务。智能家居控制:集成到智能家居设备中,允许用户通过语音控制家中的各种智能设备。游戏:在游戏中提供自然的非玩家角色(NPC)对话,增强沉浸感。辅助技术:为有视觉或行动障碍的人士提供语音控制的辅助技术。