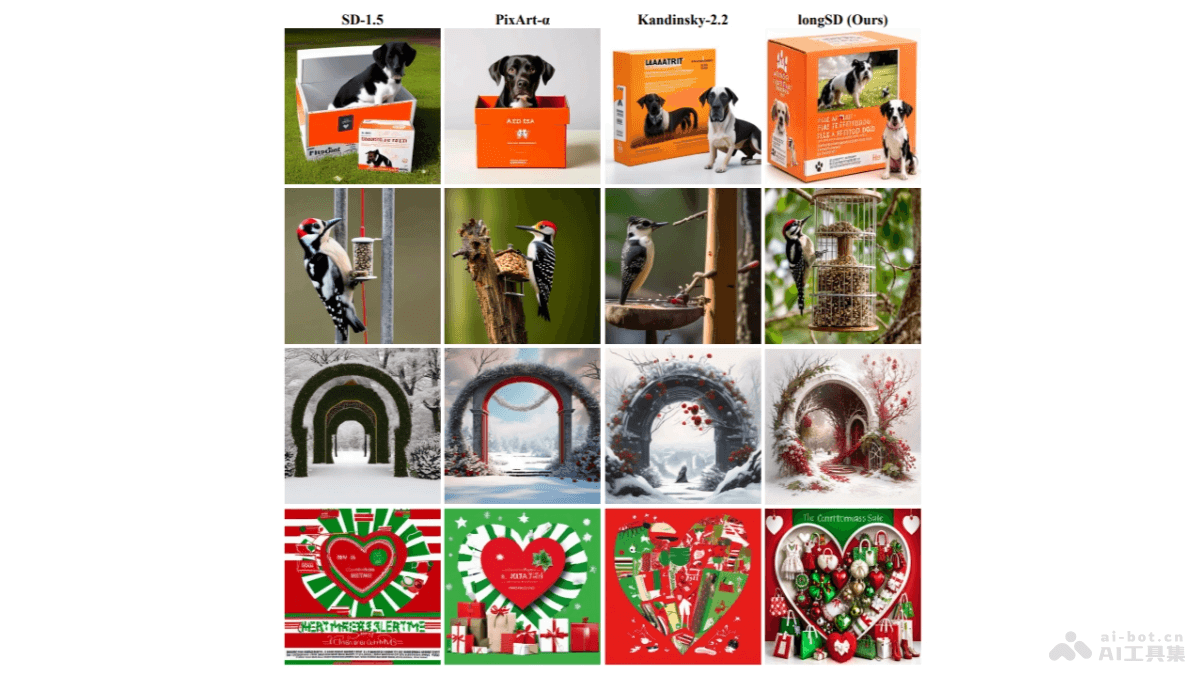

OneDiffusion是AI2推出的多功能大规模扩散模型,能无缝支持双向图像合成和理解,涵盖文本到图像生成、条件图像生成、图像理解等多种任务。基于将所有条件和目标图像建模为序列“视图”训练,实现在推理时任意帧作为条件图像的能力。OneDiffusion以其统一的训练框架、可扩展性和对多任务的支持,提供一种通用的视觉模型解决方案。

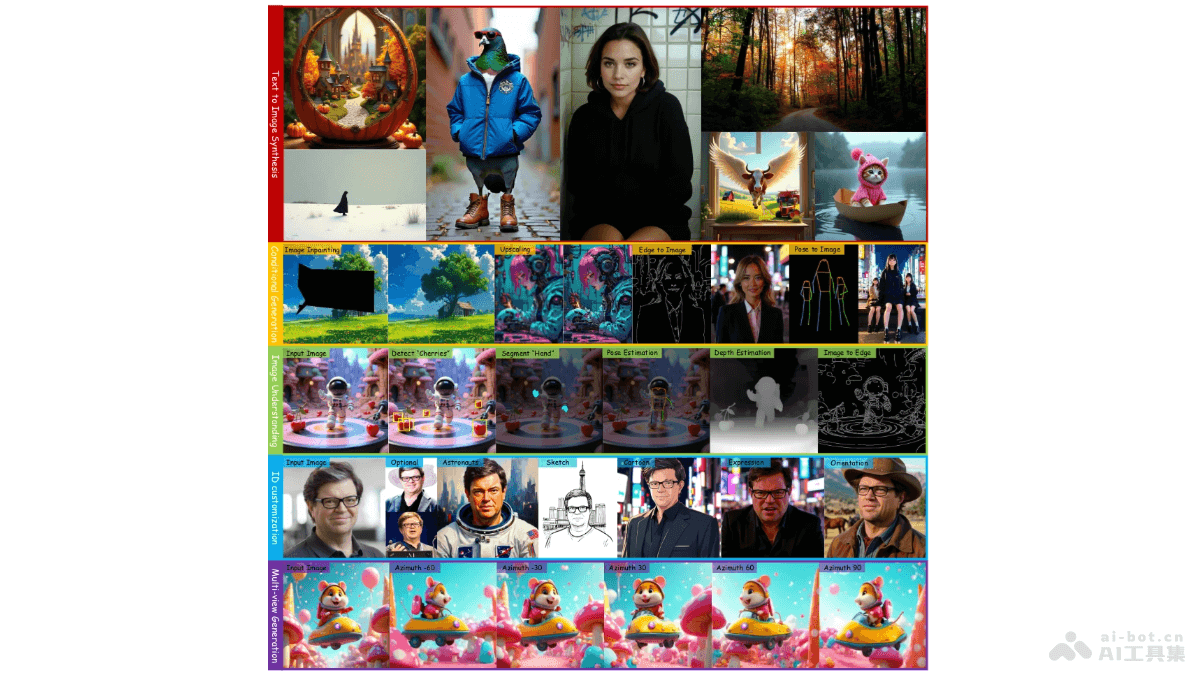

OneDiffusion的主要功能文本到图像合成:从文本提示生成高质量、逼真的图像。条件图像生成:基于输入图像(如深度图、姿态图)生成新图像。图像理解:执行如深度估计、姿态估计和图像分割等任务。多视图生成:从单一图像生成多个视角的一致视图。即时个性化:用序列图像输入进行个性化生成。ID定制:基于个人身份信息进行图像定制和生成。零样本高分辨率生成:即使在训练中未遇到高分辨率,也能生成高分辨率图像。OneDiffusion的技术原理流匹配框架:用流匹配(Flow matching)框架训练连续时间生成模型,学习时间依赖的向量场转换概率分布。序列建模:将所有条件和目标图像建模为一系列“视图”,在训练时作为序列处理,每个视图带有不同噪声水平。灵活的框架:在推理时,任何视图都能用作条件输入或被设置为噪声,生成输出图像。统一训练框架:基于统一的训练框架,去除对特定架构的需求,支持可扩展的多任务训练,并能适应任意分辨率。噪声调度:在训练过程中,独立采样每个视图的时间变量和高斯噪声,实现不同噪声水平的视图。OneDiffusion的项目地址GitHub仓库:https://github.com/lehduong/OneDiffusion/arXiv技术论文:https://arxiv.org/pdf/2411.16318OneDiffusion的应用场景艺术创作与设计:用文本到图像合成功能,艺术家和设计师从创意描述生成视觉内容,加速创作过程。广告与营销:基于条件图像生成,根据特定的品牌风格或市场趋势定制图像,用于广告和营销材料。游戏开发:在游戏设计中,快速原型设计,生成游戏环境、角色和物品的多样化视图。虚拟现实(VR)与增强现实(AR):多视图生成功能创建360度全景图像,增强VR和AR应用中的沉浸式体验。电影与娱乐:电影制作中,生成特效场景的初步草图,或用于快速预览场景布局。

OneDiffusion的主要功能文本到图像合成:从文本提示生成高质量、逼真的图像。条件图像生成:基于输入图像(如深度图、姿态图)生成新图像。图像理解:执行如深度估计、姿态估计和图像分割等任务。多视图生成:从单一图像生成多个视角的一致视图。即时个性化:用序列图像输入进行个性化生成。ID定制:基于个人身份信息进行图像定制和生成。零样本高分辨率生成:即使在训练中未遇到高分辨率,也能生成高分辨率图像。OneDiffusion的技术原理流匹配框架:用流匹配(Flow matching)框架训练连续时间生成模型,学习时间依赖的向量场转换概率分布。序列建模:将所有条件和目标图像建模为一系列“视图”,在训练时作为序列处理,每个视图带有不同噪声水平。灵活的框架:在推理时,任何视图都能用作条件输入或被设置为噪声,生成输出图像。统一训练框架:基于统一的训练框架,去除对特定架构的需求,支持可扩展的多任务训练,并能适应任意分辨率。噪声调度:在训练过程中,独立采样每个视图的时间变量和高斯噪声,实现不同噪声水平的视图。OneDiffusion的项目地址GitHub仓库:https://github.com/lehduong/OneDiffusion/arXiv技术论文:https://arxiv.org/pdf/2411.16318OneDiffusion的应用场景艺术创作与设计:用文本到图像合成功能,艺术家和设计师从创意描述生成视觉内容,加速创作过程。广告与营销:基于条件图像生成,根据特定的品牌风格或市场趋势定制图像,用于广告和营销材料。游戏开发:在游戏设计中,快速原型设计,生成游戏环境、角色和物品的多样化视图。虚拟现实(VR)与增强现实(AR):多视图生成功能创建360度全景图像,增强VR和AR应用中的沉浸式体验。电影与娱乐:电影制作中,生成特效场景的初步草图,或用于快速预览场景布局。