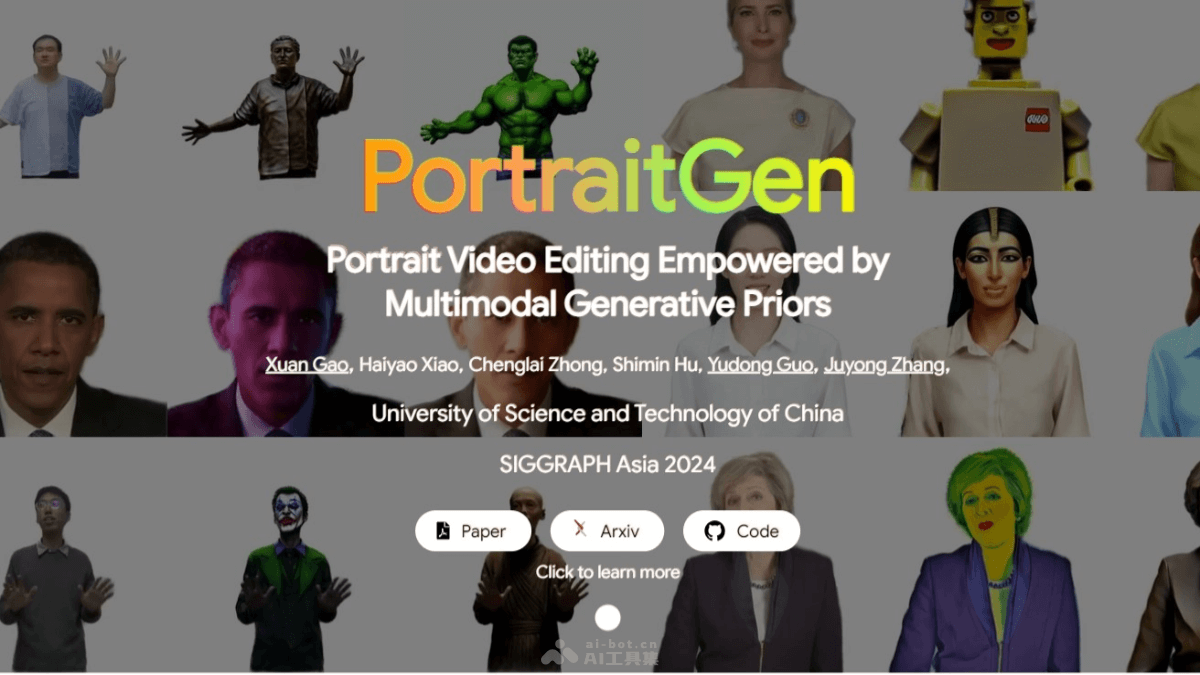

PortraitGen是中国科学技术大学研究团队推出的一款AI人像视频编辑工具。基于3D高斯溅射技术和神经高斯纹理机制,将2D人像视频转换为4D高斯场,实现高质量的3D和时间一致性编辑。工具支持多模态编辑,包括文本驱动、图像驱动编辑以及重新照明,能快速、高效地对视频中的人物进行风格化、换衣、光照调整等操作。通过面部感知编辑和表达式相似性指导,PortraitGen确保编辑后的肖像自然且与原始视频帧保持一致性。

PortraitGen的主要功能多模态人像编辑:支持文本驱动和图像驱动两种编辑模式,用户可以通过输入文字描述来指定人物的动作、表情以及场景的变化,或者用参考图像来实现风格转换或进行虚拟试穿等操作 。光照调节(Relighting):基于IC-Light技术,基于文本描述动态调整视频中的光照效果,使光照与场景自然融合 。人脸感知编辑:通过面部感知编辑模块,确保在视频编辑过程中,保留人物的面部结构和个性化特征,优化人物的表情和面部动作的自然性和一致性 。风格转换与虚拟试穿:支持风格转换和虚拟试穿,用户可以通过参考图像实现全局风格的迁移(如转换为动画风格),或为视频中的人物添加虚拟服装等物品 。多镜头和复杂场景处理:能处理多镜头视频,保持风格、人物一致性,可以通过高斯纹理技术实现复杂风格的视频渲染,如乐高风格或像素艺术风格 。快速生成与高帧率输出:能在短时间内完成编辑,生成视频时支持高达100帧每秒(FPS)的渲染速度,适合用于高效视频制作场景 。PortraitGen的技术原理3D高斯溅射(3DGS):基于3D高斯表示场景,通过3D协方差矩阵定义每个高斯的中心点、方向和大小,及不透明度和颜色属性,实现动态3D场的构建。神经高斯纹理机制:在SMPL-X模型的UV空间上维护一个3D高斯场,根据输入视频跟踪的底层网格变形来变形高斯,用UV映射和2D神经渲染器将特征图转换为RGB信号。面部感知编辑模块:对头部区域进行两次编辑,增强面部结构感知,提高编辑质量。表达式相似性指导:将渲染图像和输入源图像映射到EMOCA的潜在表达式空间,用损失函数确保表情的相似性。多模态编辑技术:结合大规模2D生成模型的知识,实现文本驱动编辑、图像驱动编辑和重新照明。PortraitGen的项目地址项目官网:ustc3dv.github.io/PortraitGenGitHub仓库:https://github.com/USTC3DV/PortraitGen-codearXiv技术论文:https://arxiv.org/pdf/2409.13591PortraitGen的应用场景电影和影视制作:在电影、电视剧或短片制作中,创建或修改角色的外貌,实现特效化妆或风格化的场景转换。艺术创作:艺术家和插画师用 PortraitGen 创作具有特定风格的人像艺术作品,如将肖像转换为像素艺术或油画风格。广告和宣传:在广告行业中,根据品牌形象或产品特点,对人物肖像进行定制化编辑,吸引目标受众。时尚行业:时尚设计师和零售商基于虚拟试穿功能,在虚拟环境中展示服装和配饰,为客户提供新的购物体验。社交媒体和短视频:内容创作者和影响者用 PortraitGen 编辑自己的肖像视频,增加创意效果,提高内容的吸引力和互动性。游戏开发:在游戏角色设计中,快速生成或编辑角色的外貌,提高游戏的个性化和丰富性。

PortraitGen的主要功能多模态人像编辑:支持文本驱动和图像驱动两种编辑模式,用户可以通过输入文字描述来指定人物的动作、表情以及场景的变化,或者用参考图像来实现风格转换或进行虚拟试穿等操作 。光照调节(Relighting):基于IC-Light技术,基于文本描述动态调整视频中的光照效果,使光照与场景自然融合 。人脸感知编辑:通过面部感知编辑模块,确保在视频编辑过程中,保留人物的面部结构和个性化特征,优化人物的表情和面部动作的自然性和一致性 。风格转换与虚拟试穿:支持风格转换和虚拟试穿,用户可以通过参考图像实现全局风格的迁移(如转换为动画风格),或为视频中的人物添加虚拟服装等物品 。多镜头和复杂场景处理:能处理多镜头视频,保持风格、人物一致性,可以通过高斯纹理技术实现复杂风格的视频渲染,如乐高风格或像素艺术风格 。快速生成与高帧率输出:能在短时间内完成编辑,生成视频时支持高达100帧每秒(FPS)的渲染速度,适合用于高效视频制作场景 。PortraitGen的技术原理3D高斯溅射(3DGS):基于3D高斯表示场景,通过3D协方差矩阵定义每个高斯的中心点、方向和大小,及不透明度和颜色属性,实现动态3D场的构建。神经高斯纹理机制:在SMPL-X模型的UV空间上维护一个3D高斯场,根据输入视频跟踪的底层网格变形来变形高斯,用UV映射和2D神经渲染器将特征图转换为RGB信号。面部感知编辑模块:对头部区域进行两次编辑,增强面部结构感知,提高编辑质量。表达式相似性指导:将渲染图像和输入源图像映射到EMOCA的潜在表达式空间,用损失函数确保表情的相似性。多模态编辑技术:结合大规模2D生成模型的知识,实现文本驱动编辑、图像驱动编辑和重新照明。PortraitGen的项目地址项目官网:ustc3dv.github.io/PortraitGenGitHub仓库:https://github.com/USTC3DV/PortraitGen-codearXiv技术论文:https://arxiv.org/pdf/2409.13591PortraitGen的应用场景电影和影视制作:在电影、电视剧或短片制作中,创建或修改角色的外貌,实现特效化妆或风格化的场景转换。艺术创作:艺术家和插画师用 PortraitGen 创作具有特定风格的人像艺术作品,如将肖像转换为像素艺术或油画风格。广告和宣传:在广告行业中,根据品牌形象或产品特点,对人物肖像进行定制化编辑,吸引目标受众。时尚行业:时尚设计师和零售商基于虚拟试穿功能,在虚拟环境中展示服装和配饰,为客户提供新的购物体验。社交媒体和短视频:内容创作者和影响者用 PortraitGen 编辑自己的肖像视频,增加创意效果,提高内容的吸引力和互动性。游戏开发:在游戏角色设计中,快速生成或编辑角色的外貌,提高游戏的个性化和丰富性。