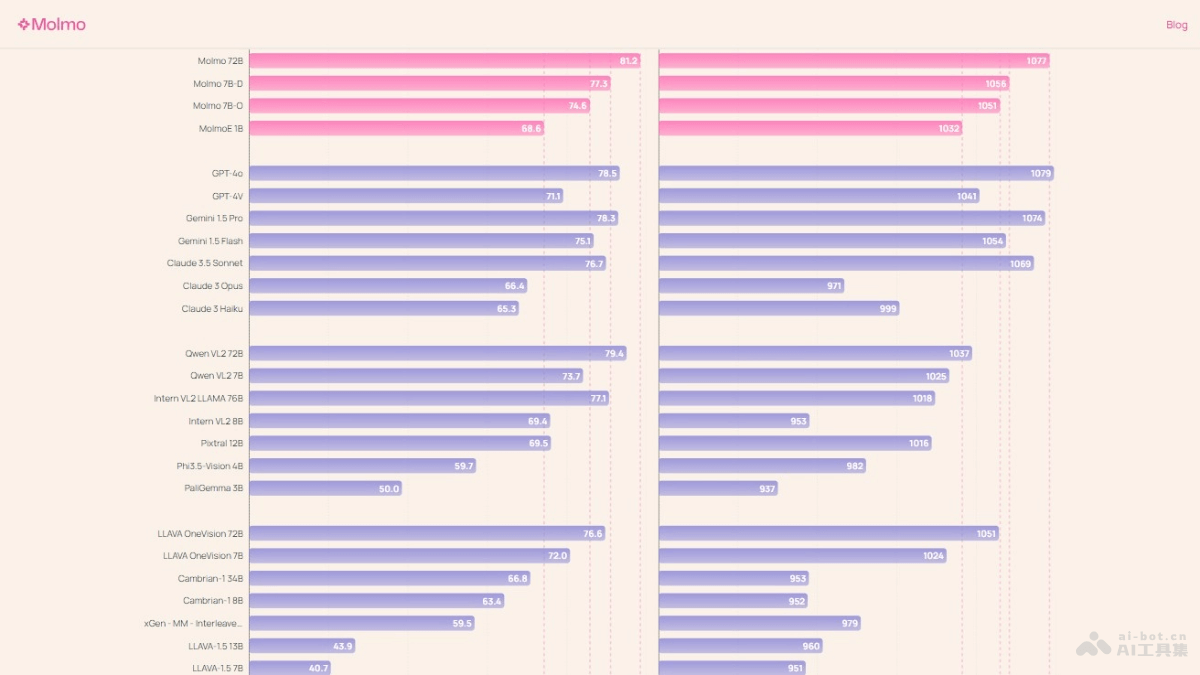

Molmo 72B是由艾伦人工智能研究所(Ai2)推出的一个开源多模态AI模型,专门设计用于处理和理解图像和文本数据。基于Qwen2-72B模型,使用OpenAI的CLIP作为视觉编码器。Molmo 72B在多个学术基准测试中表现优异,击败包括Llama 3.2 90B在内的其他模型。Molmo 72B能执行图像描述、视觉问答等任务,能理解和与用户界面交互。Molmo 72B的发布,进一步推动开源AI的发展,为研究人员和开发者提供强大的工具。

Molmo 72B的主要功能图像描述生成:根据输入的图像内容生成详细的描述性文本。视觉问答(VQA):能理解关于图像的问题并提供准确的答案。文档理解:能解析和理解图像中的文本信息,如菜单、图表等。多模态交互:结合图像和文本输入,提供更丰富的交互体验。用户界面交互:能识别和解释用户界面元素,如按钮、链接等。Molmo 72B的技术原理多模态架构:Molmo 72B结合视觉和语言处理模型,用视觉编码器(如CLIP)处理图像数据,以及语言模型(如Qwen2-72B)处理文本数据。高质量的训练数据:基于语音的图像描述生成方法,收集大量高质量的图像-文本对数据,提高模型的训练效果。先进的模型训练:模型在多个阶段进行训练,包括预训练、多模态预训练和有监督的微调。评估和基准测试:在多个学术基准测试中进行评估,通过大规模人类评估验证模型性能和用户偏好。模型变体:Molmo家族包括不同规模的模型,适应不同的应用需求和计算资源限制。Molmo 72B的项目地址项目官网:molmo.allenai.orgHuggingFace模型库:https://huggingface.co/allenai/Molmo-72B-0924Molmo 72B的应用场景图像内容分析:在电子商务网站上,Molmo 72B分析产品图片,生成描述性的文本,帮助用户理解商品特点。辅助视觉问答:在教育领域,回答学生关于图像内容的问题,如历史图片、科学图表等。内容审核:在社交媒体和内容平台,Molmo 72B帮助识别和过滤不适当的图像内容。智能助手:在智能家居设备中,解释用户的图像指令,比如通过摄像头理解家庭安全系统的图像并做出响应。增强现实(AR):在AR应用中,Molmo 72B识别现实世界中的物体,并在图像上叠加相关信息或虚拟元素。虚拟现实(VR):在VR游戏中,创建更加丰富和互动的虚拟环境。

Molmo 72B的主要功能图像描述生成:根据输入的图像内容生成详细的描述性文本。视觉问答(VQA):能理解关于图像的问题并提供准确的答案。文档理解:能解析和理解图像中的文本信息,如菜单、图表等。多模态交互:结合图像和文本输入,提供更丰富的交互体验。用户界面交互:能识别和解释用户界面元素,如按钮、链接等。Molmo 72B的技术原理多模态架构:Molmo 72B结合视觉和语言处理模型,用视觉编码器(如CLIP)处理图像数据,以及语言模型(如Qwen2-72B)处理文本数据。高质量的训练数据:基于语音的图像描述生成方法,收集大量高质量的图像-文本对数据,提高模型的训练效果。先进的模型训练:模型在多个阶段进行训练,包括预训练、多模态预训练和有监督的微调。评估和基准测试:在多个学术基准测试中进行评估,通过大规模人类评估验证模型性能和用户偏好。模型变体:Molmo家族包括不同规模的模型,适应不同的应用需求和计算资源限制。Molmo 72B的项目地址项目官网:molmo.allenai.orgHuggingFace模型库:https://huggingface.co/allenai/Molmo-72B-0924Molmo 72B的应用场景图像内容分析:在电子商务网站上,Molmo 72B分析产品图片,生成描述性的文本,帮助用户理解商品特点。辅助视觉问答:在教育领域,回答学生关于图像内容的问题,如历史图片、科学图表等。内容审核:在社交媒体和内容平台,Molmo 72B帮助识别和过滤不适当的图像内容。智能助手:在智能家居设备中,解释用户的图像指令,比如通过摄像头理解家庭安全系统的图像并做出响应。增强现实(AR):在AR应用中,Molmo 72B识别现实世界中的物体,并在图像上叠加相关信息或虚拟元素。虚拟现实(VR):在VR游戏中,创建更加丰富和互动的虚拟环境。