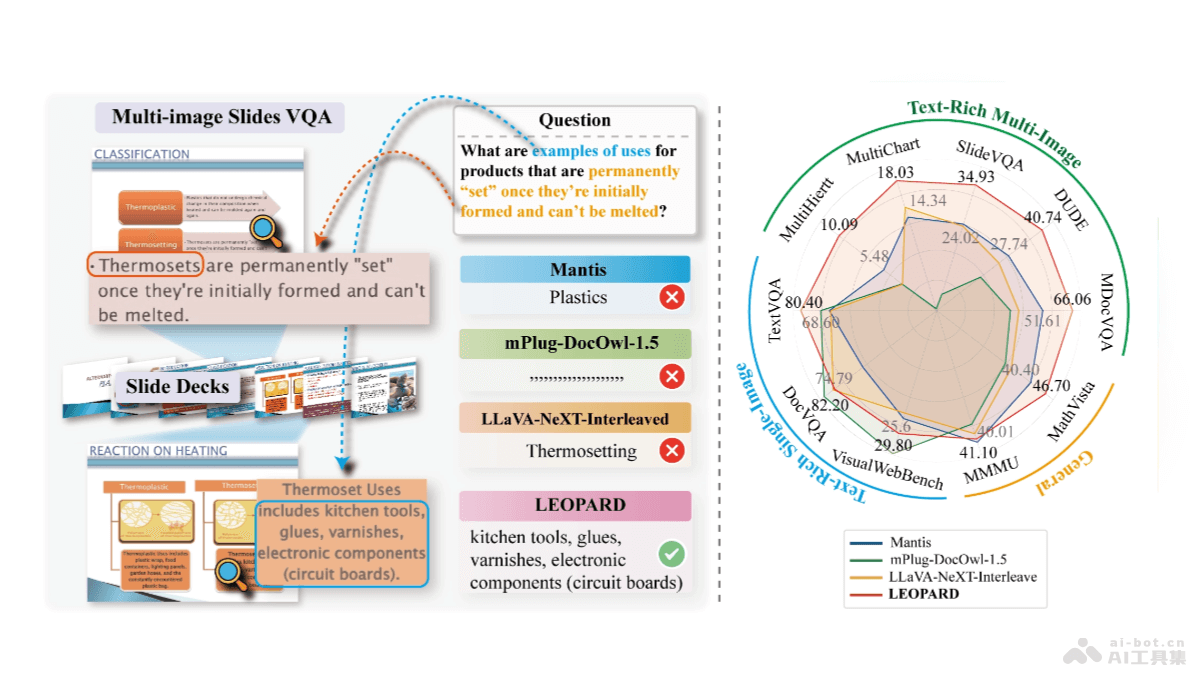

LEOPARD是腾讯AI Lab西雅图实验室推出的视觉语言模型,专为理解和处理含有大量文本的多图像任务设计。LEOPARD基于两个主要技术创新:一是策划约一百万条专门针对文本丰富、多图像场景的高质量多模态指令调优数据集;二是开发自适应高分辨率多图像编码模块,动态优化视觉序列长度分配。LEOPARD在多个基准测试中展现卓越的性能,在需要理解单个图像内容及跨多个视觉输入进行推理的复杂任务中表现出色。

LEOPARD的主要功能处理文本丰富的多图像任务:用于理解和处理包含大量文本信息的多图像场景,如幻灯片、扫描文档和网页截图等。跨图像推理:模型能理解单个图像的内容,在多个图像间进行逻辑推理和关系建立。高分辨率图像处理:基于自适应高分辨率多图像编码模块,能有效处理高分辨率图像,保持文本和细节的清晰度。动态视觉序列长度优化:根据输入图像的原始纵横比和分辨率动态优化视觉序列长度,平衡图像细节和模型处理能力。多模态指令调优:用大规模多模态指令调优数据集,能针对复杂的视觉语言任务进行优化。LEOPARD的技术原理多模态大型语言模型(MLLM):基于MLLM架构,整合视觉编码器、视觉语言连接器和语言模型,处理视觉和文本信息。数据集构建:构建LEOPARD-INSTRUCT数据集,包含约一百万条针对文本丰富、多图像场景的指令,用在模型训练和优化。自适应高分辨率编码:基于自适应策略,根据输入图像的特性动态调整视觉特征序列,适应模型的序列长度限制。像素洗牌技术:应用像素洗牌操作,将长视觉特征序列无损压缩成更短的序列,便于模型处理更多的高分辨率图像。图像分割:将高分辨率图像分割成多个子图像,以便独立处理并保留细节,然后将视觉特征与文本信息一起输入到语言模型中。LEOPARD的项目地址GitHub仓库:https://github.com/tencent-ailab/LeopardHuggingFace模型库:https://huggingface.co/datasets/wyu1/Leopard-InstructarXiv技术论文:https://arxiv.org/pdf/2410.01744LEOPARD的应用场景自动化文档理解:处理多页文档,如合同、报告和学术论文,自动提取关键信息和数据。教育和学术研究:辅助教育工具,如电子课件和学术演示文稿,提供交互式学习体验。商业智能和数据分析:分析商业图表和表格,提供市场趋势预测和决策支持。网页内容分析:理解和提取网页内容,用于搜索引擎优化(SEO)和内容推荐系统。客户服务和支持:基于分析用户上传的图像和文本,提供更准确的客户服务和技术支持。

LEOPARD的主要功能处理文本丰富的多图像任务:用于理解和处理包含大量文本信息的多图像场景,如幻灯片、扫描文档和网页截图等。跨图像推理:模型能理解单个图像的内容,在多个图像间进行逻辑推理和关系建立。高分辨率图像处理:基于自适应高分辨率多图像编码模块,能有效处理高分辨率图像,保持文本和细节的清晰度。动态视觉序列长度优化:根据输入图像的原始纵横比和分辨率动态优化视觉序列长度,平衡图像细节和模型处理能力。多模态指令调优:用大规模多模态指令调优数据集,能针对复杂的视觉语言任务进行优化。LEOPARD的技术原理多模态大型语言模型(MLLM):基于MLLM架构,整合视觉编码器、视觉语言连接器和语言模型,处理视觉和文本信息。数据集构建:构建LEOPARD-INSTRUCT数据集,包含约一百万条针对文本丰富、多图像场景的指令,用在模型训练和优化。自适应高分辨率编码:基于自适应策略,根据输入图像的特性动态调整视觉特征序列,适应模型的序列长度限制。像素洗牌技术:应用像素洗牌操作,将长视觉特征序列无损压缩成更短的序列,便于模型处理更多的高分辨率图像。图像分割:将高分辨率图像分割成多个子图像,以便独立处理并保留细节,然后将视觉特征与文本信息一起输入到语言模型中。LEOPARD的项目地址GitHub仓库:https://github.com/tencent-ailab/LeopardHuggingFace模型库:https://huggingface.co/datasets/wyu1/Leopard-InstructarXiv技术论文:https://arxiv.org/pdf/2410.01744LEOPARD的应用场景自动化文档理解:处理多页文档,如合同、报告和学术论文,自动提取关键信息和数据。教育和学术研究:辅助教育工具,如电子课件和学术演示文稿,提供交互式学习体验。商业智能和数据分析:分析商业图表和表格,提供市场趋势预测和决策支持。网页内容分析:理解和提取网页内容,用于搜索引擎优化(SEO)和内容推荐系统。客户服务和支持:基于分析用户上传的图像和文本,提供更准确的客户服务和技术支持。