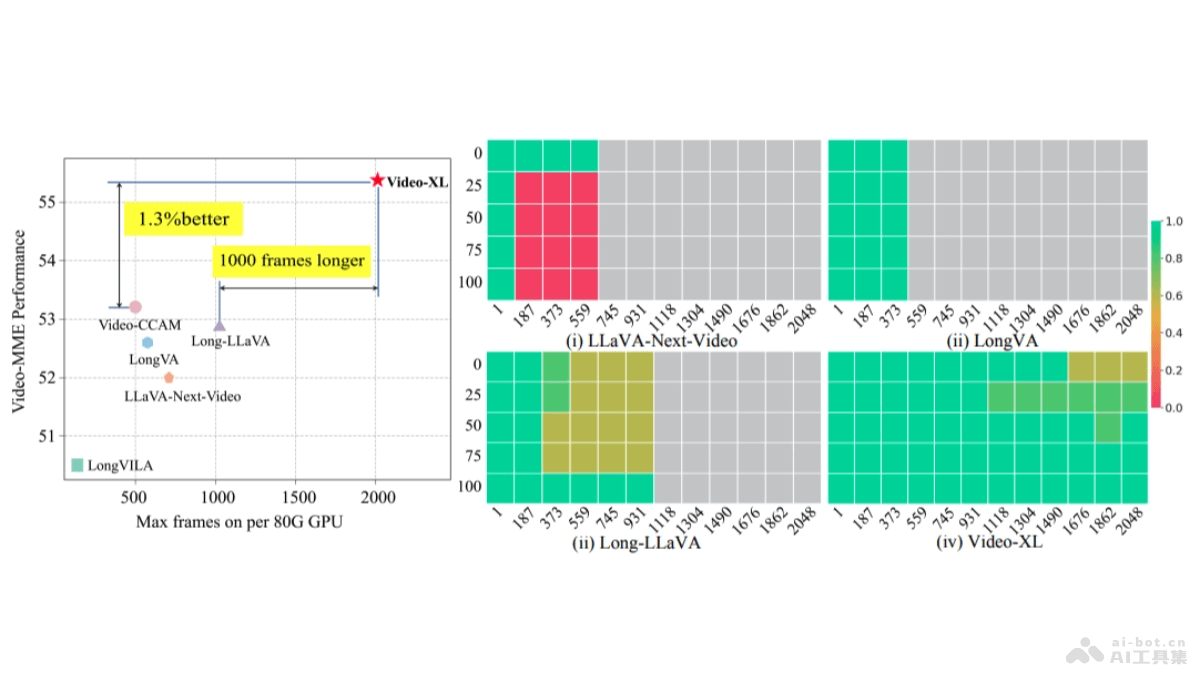

Video-XL是北京智源人工智能研究院联合上海交大、中国人民大学、中科院、北邮和北大的研究人员共同推出的专为小时级视频理解设计的超长视觉理解模型。基于视觉上下文潜在总结技术将视觉信息压缩成紧凑的形式,提高处理效率、减少信息丢失。在多个长视频理解基准测试中表现出色,例如在VNBench上准确率比现有最佳方法高出近10%,在单个80GB GPU上处理2048帧视频时,准确率接近95%。Video-XL展示了在效率和效果之间取得平衡的能力,在长视频特定任务如电影总结、监控异常检测和广告放置识别等方面具有潜力。

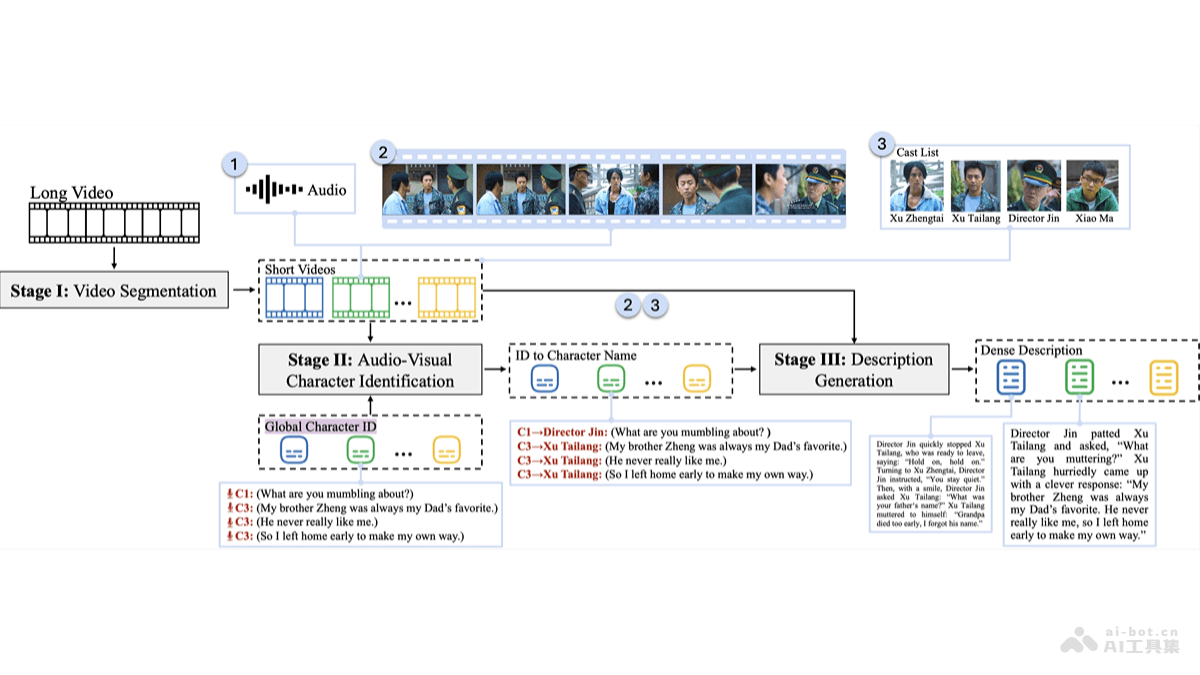

Video-XL的主要功能小时级视频理解:Video-XL能处理非常长的视频,达到小时级别的视频内容理解。视觉压缩:基于视觉上下文潜在总结技术,将大量的视觉信息压缩成更紧凑的形式,适应模型的处理能力。高效计算:在保持高准确率的同时,减少计算资源消耗,在单个GPU上能处理大量视频帧。多模态数据处理:处理包括单图像、多图像和视频在内的多种数据类型。长视频特定任务处理:适于电影总结、监控异常检测和广告放置识别等长视频相关的特定任务。Video-XL的技术原理视觉上下文潜在总结(Visual Context Latent Summarization):引入视觉总结标记(VSTs),将原始视觉上下文的激活(例如自注意力模块中的键和值)压缩成高度紧凑的表示。分块处理:将视觉标记序列分割成相同大小的块,在每个块中插入VSTs,用LLM逐步压缩视觉信号。自回归方法:在编码每个块的过程中,除了用额外的投影矩阵外,Video-XL重用所有模块转换VST隐藏状态,将视觉信号的信息压缩到VST的激活中。统一的视觉编码方案:将单图像、多图像和视频统一编码到同一空间,处理不同的多模态数据。长视频数据集(VICO):开发新的长视频数据集,专门用在处理更长的视频和动态视觉上下文,增强模型的长视频理解能力。Video-XL的项目地址GitHub仓库:https://github.com/VectorSpaceLab/Video-XLHuggingFace模型库:https://huggingface.co/sy1998/Video_XLarXiv技术论文:https://arxiv.org/pdf/2409.14485Video-XL的应用场景电影和视频内容总结:Video-XL能理解和总结长视频内容,如电影或电视剧的主要情节和事件,为用户提供简洁的概述。视频监控分析:在安全监控领域,用在异常行为检测,识别监控视频中的异常事件或不寻常活动。广告投放和分析:Video-XL帮助分析视频内容中的广告放置效果,理解广告与视频内容的关联性,及观众对广告的反应。教育和培训视频:在教育领域,Video-XL用在理解和总结长时间的教学视频,帮助学生快速把握课程要点。视频内容检索:Video-XL用在视频数据库中的内容检索,帮助用户快速找到视频中的关键片段或相关信息。

Video-XL的主要功能小时级视频理解:Video-XL能处理非常长的视频,达到小时级别的视频内容理解。视觉压缩:基于视觉上下文潜在总结技术,将大量的视觉信息压缩成更紧凑的形式,适应模型的处理能力。高效计算:在保持高准确率的同时,减少计算资源消耗,在单个GPU上能处理大量视频帧。多模态数据处理:处理包括单图像、多图像和视频在内的多种数据类型。长视频特定任务处理:适于电影总结、监控异常检测和广告放置识别等长视频相关的特定任务。Video-XL的技术原理视觉上下文潜在总结(Visual Context Latent Summarization):引入视觉总结标记(VSTs),将原始视觉上下文的激活(例如自注意力模块中的键和值)压缩成高度紧凑的表示。分块处理:将视觉标记序列分割成相同大小的块,在每个块中插入VSTs,用LLM逐步压缩视觉信号。自回归方法:在编码每个块的过程中,除了用额外的投影矩阵外,Video-XL重用所有模块转换VST隐藏状态,将视觉信号的信息压缩到VST的激活中。统一的视觉编码方案:将单图像、多图像和视频统一编码到同一空间,处理不同的多模态数据。长视频数据集(VICO):开发新的长视频数据集,专门用在处理更长的视频和动态视觉上下文,增强模型的长视频理解能力。Video-XL的项目地址GitHub仓库:https://github.com/VectorSpaceLab/Video-XLHuggingFace模型库:https://huggingface.co/sy1998/Video_XLarXiv技术论文:https://arxiv.org/pdf/2409.14485Video-XL的应用场景电影和视频内容总结:Video-XL能理解和总结长视频内容,如电影或电视剧的主要情节和事件,为用户提供简洁的概述。视频监控分析:在安全监控领域,用在异常行为检测,识别监控视频中的异常事件或不寻常活动。广告投放和分析:Video-XL帮助分析视频内容中的广告放置效果,理解广告与视频内容的关联性,及观众对广告的反应。教育和培训视频:在教育领域,Video-XL用在理解和总结长时间的教学视频,帮助学生快速把握课程要点。视频内容检索:Video-XL用在视频数据库中的内容检索,帮助用户快速找到视频中的关键片段或相关信息。